iPhones terão detecção de imagens de abuso infantil

Ler em outras línguas:

A Apple anunciou novos recursos contra imagens de abuso infantil para seus sistemas operacionais, poucas horas depois do jornal Financial Times revelar a novidade. As versões atualizadas do iOS, iPadOS, macOS e watchOS esperadas para o final do ano devem contar com ferramentas para combater a disseminação dos conteúdos.

TL;DR

- App Mensagens alertará sobre conteúdo sexualmente explícito;

- Material com abuso infantil será identificado no iCloud Photos;

- Siri e Busca terão ferramentas adicionais para alertar contra abuso infantil.

O Financial Times publicou na tarde desta quinta-feira (6) as novidades, e pouco tempo depois a Apple confirmou os novos sistemas de prevenção ao abuso infantil com um comunicado oficial e um relatório técnico (PDF) de como recurso funcionará.

A partir do iOS 15, iPadOS 15, watchOS 8 e macOS Monterey — inicialmente apenas nos Estados Unidos — os dispositivos atualizados terão recursos adicionais para prevenir e alertar contra a disseminação de conteúdos com abuso infantil.

Alertas para pais e responsáveis no Mensagens

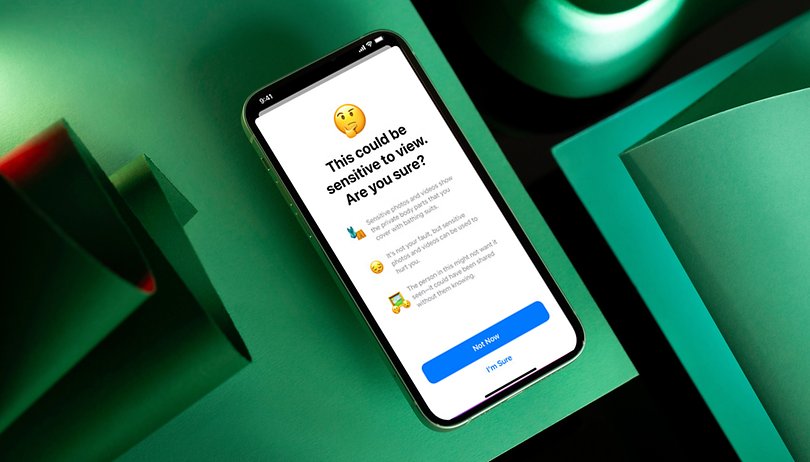

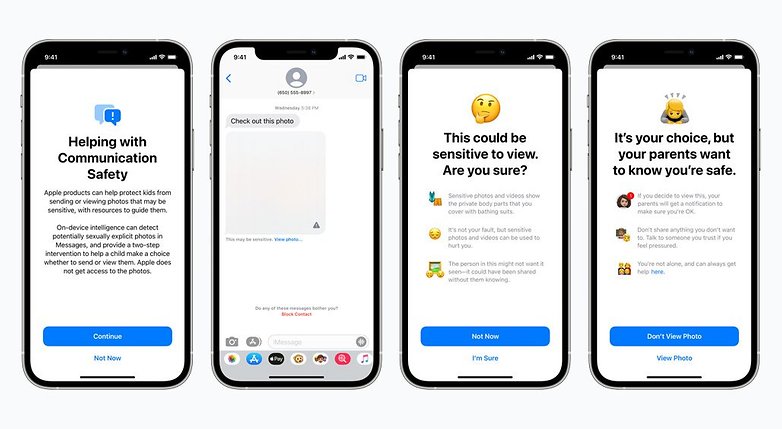

O app Mensagens detectará o recebimento e envio de imagens sexualmente explícitas. No caso de imagens recebidas, elas serão escondidas com um efeito de embaçamento (blur), e só poderão ser vistas após concordar com um alerta de que o conteúdo pode ser impróprio (a terceira captura na imagem abaixo).

Os pais ou responsáveis terão ainda a opção de serem alertados caso a criança visualize conteúdos identificados pelo Mensagens — que, segundo a Apple, fará a análise no próprio aparelho, sem que a empresa tenha acesso aos conteúdos.

O novo recurso será integrado às atuais opções de contas familiares no iOS 15, iPadOS 15 e macOS Monterey.

Detecção no iCloud Photos

O recurso que deve atrair mais atenção é a nova tecnologia anunciada pela Apple para detectar imagens que contenham cenas de abuso infantil no iCloud. A ferramenta será capaz de identificar imagens pré-cadastradas pelo NCMEC (National Center for Missing and Exploited Children, uma organização norte-americana para crianças desaparecidas e exploradas).

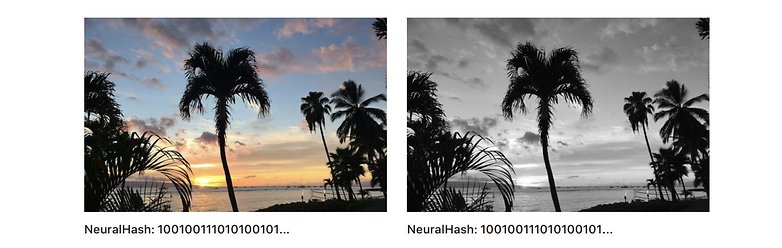

Apesar de identificar arquivos armazenados na nuvem, o sistema funcionará com base em um cruzamento de dados feito no próprio dispositivo — uma preocupação repetida diversas vezes pela Apple — utilizando hashes (identificadores) das imagens do NCMEC e outras organizações.

Segundo a Apple, o hash não é alterado com mudanças de tamanho de arquivo, ou mesmo com a remoção de cores ou alteração do nível de compressão da imagem. A empresa não poderá interpretar os resultados das análises, a não ser que a conta ultrapasse um volume — não revelado — de identificações positivas.

Ainda de acordo com a Apple, o sistema possui uma probabilidade de erro inferior a uma por um trilhão ao ano. Ao identificar uma conta potencialmente infratora, será feita uma avaliação das imagens analisadas e caso a identificação seja confirmada, um relatório é enviado ao NCMEC após a desativação da conta, decisão que pode ser protestada pelo dono do perfil.

Antes mesmo do anúncio oficial da nova ferramenta, especialistas em criptografia alertaram sobre o risco do novo recurso abrir as portas para a aplicação de sistemas semelhantes com outros propósitos, como espionagem por governos ditatoriais, contornando as dificuldades impostas pelos sistemas de criptografia de ponta a ponta.

Por enquanto, a Apple não indicou quando (ou mesmo se) o sistema estará disponível em outras regiões. Há ainda questões como a adequação a leis como a europeia GDPR, ou até mesmo a brasileira LGPD.

Siri também intervém

O pacote de novidades é completado pela Siri em conjunto com o sistema de buscas dos sistemas operacionais, eles passarão a fornecer informações sobre segurança online, inclusive com links para fazer denúncias de abuso.

Assim como os demais recursos, as orientações adicionais devem ser oferecidas inicialmente apenas nos Estados Unidos, e não têm previsão de quando serão disponibilizadas em outras regiões.

No Brasil, para denunciar casos de maus-tratos e negligência contra crianças e adolescentes, ligue para o número 100 — a ligação é gratuita e anônima, com atendimento 24 horas por dia, 7 dias por semana. Além do telefone, o Ministério da Mulher, da Família e dos Direitos Humanos recebe denúncias também pelo site, no link "Disque 100".

Fonte: Apple